2025年4月19日,计通学院论文精读沙龙第一期在机电楼619成功举行。我院2023级硕士生郭子正以《基于高效时空建模的微视觉计算方法》为题,带来了一场深度技术分享,系统介绍了他在微视觉计算领域关于高效时空建模的一些探索工作。

一、技术攻坚:让机器看懂"看不见"的信号

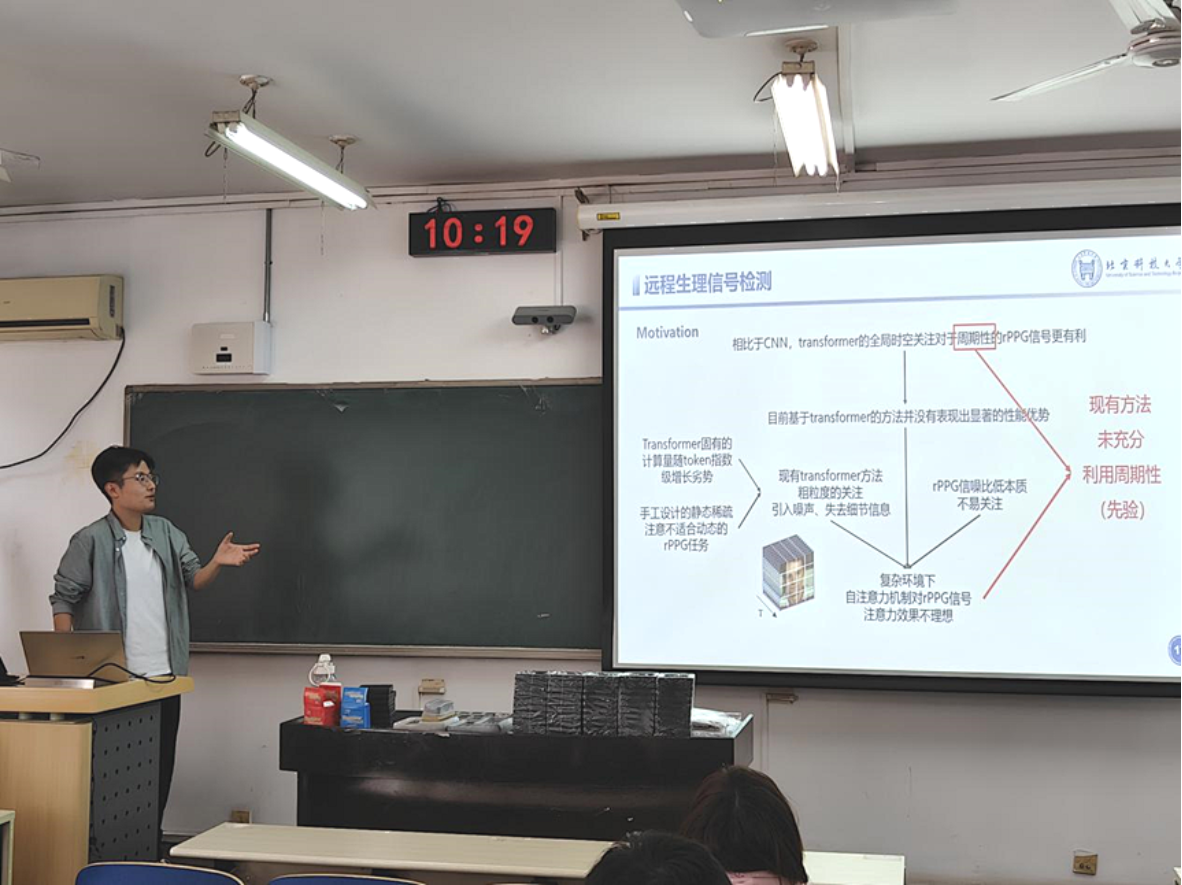

微视觉计算致力于对微弱视觉信息(非接触面部生理信号、微表情等)进行精细化建模。与传统视觉计算相比,微视觉计算面临更突出的时空冗余与长程感知之间的矛盾:一方面,微弱信号的低信噪比特性要求更精细的特征提取;另一方面,其微弱的时空模式可能蕴含着更大的时空冗余。针对这一挑战,他聚焦于基于面部视频的远程生理信号检测和微表情分析两大应用场景,探讨了基于Transformer稀疏注意与Mamba架构的创新时空建模方法:

认知启发的周期稀疏注意机制:通过模拟人类视觉的注意力机制,优先聚焦脉搏波信号最关键的周期特性。基于由周期性引发的时序注意稀疏性实现细粒度的注意,进而实现对微弱信号的精准识别。

任务导向的状态空间模型:结合微视觉信号的特点进行针对性设计,将空间信息融入通道,粗粒度的扩展Token的信息,使其可以充分表示信号状态,进而实现在极低计算成本下对微弱信号的鲁棒表征。

二、前沿探讨:大模型与微视觉的创新结合

沙龙中,郭子正还分享了微视觉计算领域内将大模型结合的前沿工作。他概述了两种主要思路:

其一,是通过赋予大模型以微视觉感知能力,利用这些模型强大的语言处理能力来理解微视觉计算的结果。

其二,则是借助大模型为微视觉感知赋能,即利用视觉基础模型卓越的视觉能力来提升微视觉计算的性能。

三、智能革命:大模型的未来展望

在最后的交流互动环节中,当被同学们问及大模型的发展前景时,郭子正表达了他的见解。他认为,当前大模型已从实验室研究迈向产业应用,例如在自动驾驶中通过实时环境感知提升决策能力,在“搜广推”领域实现用户行为驱动的精准服务。未来,随着多模态交互技术与垂直领域模型的深化发展,大模型将进一步推动产业智能化升级,为社会生产力带来质的飞跃。