喜报——计算机与通信工程学院两篇论文被CVPR录用

近日,计算机与通信工程学院2篇论文被计算机视觉领域三大顶级会议之一 ——IEEE国际计算机视觉与模式识别会议(CVPR,IEEEConference on Computer Vision and Pattern Recognition)录用,研究成果分别来自物联网与电子工程系三维图像认知与仿真实验室和计算机科学与技术系模式识别与人工智能技术创新实验室,祝贺老师同学们!

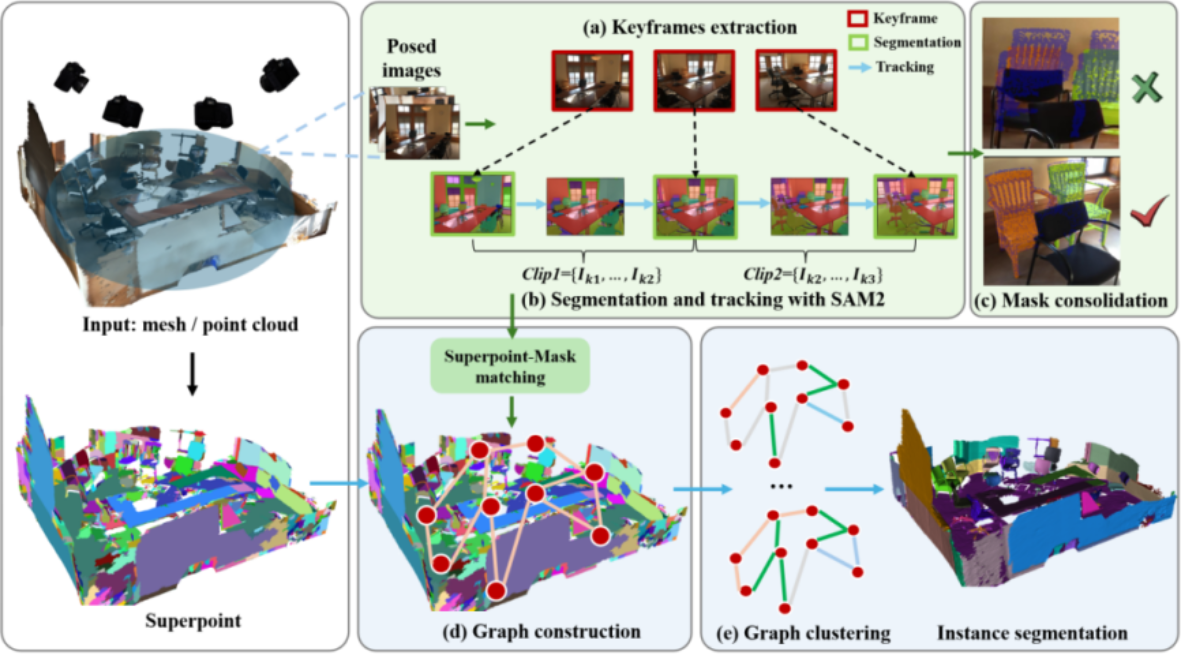

一、标题:SAM2Object: Consolidating View Consistency via SAM2 for Zero-Shot 3D Instance Segmentation

作者:赵基淮

导师:马惠敏

论文概述:

在零样本3D实例分割领域,现有的2D-to-3D Lifting方法通常依赖视觉基础模型对多帧RGB图像进行2D分割,然后将结果投影并合并至3D空间。然而,由于这些模型在单帧上的推理未与相邻帧协同,导致同一对象在不同帧中的Mask不一致,缺乏视角一致性。此外,当前的提升方法在3D投影过程中对多视角2D分割进行均值融合,未区分Mask质量,使低质量和高质量Mask被赋予相同权重,导致3D分割碎片化。为此,本文提出SAM2Object,一种全新的零样本3D实例分割方法。我们利用SegmentAnything Model 2(SAM2)进行目标分割与跟踪,确保多帧间的视角一致性,进一步结合这些一致的2D Mask与3D几何先验,提升3D分割的鲁棒性。此外,我们引入Mask Consolidation模块,过滤跨帧低质量Mask,实现更精确的3D-2D匹配。在ScanNetV2、ScanNet++ 和ScanNet200等数据集上的评估表明,SAM2Object在零样本3D实例分割任务中表现优越,展现出卓越的鲁棒性和有效性,并超越现有方法。

二、标题:DPFlow: Adaptive Optical Flow Estimation with a Dual-Pyramid Framework

作者:MORIMITSU HENRIQUE(恩瑞)

导师:殷绪成

论文概述:

通过光流估计提取的运动信息对于多种基于视频的应用至关重要,包括自主导航、视频修复、动作识别以及人机交互。随着视频技术向8K分辨率迈进,一个显著的挑战随之而来,因为现有的光流方法主要针对低分辨率输入进行设计和优化。当前方法在处理这些更大输入尺寸时面临困难,原因在于全局匹配方法的计算限制、基于Transformer模型的输入尺寸约束,以及其他方法在处理高分辨率视频时的性能下降。此外,缺乏全面的基准和定量评估来准确衡量光流在这些高分辨率下的表现。为了填补高分辨率光流估计的这一空白,本文提出了两项关键贡献。首先,介绍了DPFlow,这是一种采用双金字塔双向循环编码器的新型光流架构。DPFlow旨在适应不同输入尺寸,即使仅在低分辨率数据上训练,也能有效地泛化到8K分辨率。它在多个基准测试中实现了最先进的性能,包括MPI-Sintel、KITTI和Spring基准。其次,本文引入了Kubric-NK,这是一个包含从1K到8K分辨率密集标注样本的新数据集。该数据集作为首个系统评估光流方法在极高分辨率下表现的平台,使人们能够更深入地理解输入分辨率如何影响预测精度。

(责编:王钰健)